Nepasitikėjimas dirbtiniu intelektu – plati tema. Vienas iš daugelio su tuo susijusių klausimų – koks šioje srityje teisės vaidmuo? Ekspertai kol kas nesutaria, kiek tikėtina, kad ateityje robotai vaikščios tarp mūsų, ir kokią riziką tai galėtų sukelti. Vis dėlto, pasak straipsnio autoriaus, autonominės technologijos, pajėgios pridaryti mums žalos, jau egzistuoja.

Teisininkai šmaikštauja – „yra kaltė, bus ir ieškinys“. Tačiau ką reikėtų kaltinti, jei prisidirba robotas? Žinoma, tokią problemą būtų galima apskritai paneigti, motyvuojant, esą ji pernelyg abstrakti, kad reikėtų dėl jos jaudintis. Tačiau prisiminkime, sako Ch. Markou, atvejus, kai robotas buvo suimtas už tai, kad mėgino įsigyti narkotikų (vėliau paleistas nepateikus kaltinimų), o bendrovė „Tesla Motors“ atleista nuo atsakomybės po to, kai, įsijungęs autopilotą, kelyje žuvo „Tesla“ vairuotojas.

Robotai nėra teisės subjektai

Teisės vaidmuo šioje srityje gali būti apibrėžiamas įvairiai, tačiau jos pagrindinė paskirtis – sureguliuoti žmonių lūkesčius. Jei mus užpuola, mes tikimės, kad užpuolikui bus pateikti kaltinimai ir jis bus atitinkamai nubaustas.

Tačiau ir teisė iš mūsų šio bei to tikisi – turime stengtis, pasitelkdami visas savo sąmoningumo galias, jos laikytis. Esame protaujantys individai, todėl tai daryti mums iš principo nėra sunku. Gebame savarankiškai nuspręsti – viršyti greitį ar paisyti greičio apribojimų. Taigi, kaip sakoma, esame teisės subjektai.

Įmonėms taip pat suteikta garbė vadintis teisės subjektais. Šis statusas joms garantuoja įvairias ekonomines ir juridines teises, tačiau svarbiausia – saisto jas tam tikromis prievolėmis. Taigi, jei bendrovė X sukuria autonominį automobilį, ji privalo laikytis ir atitinkamų su tuo susijusių teisinių prievolių.

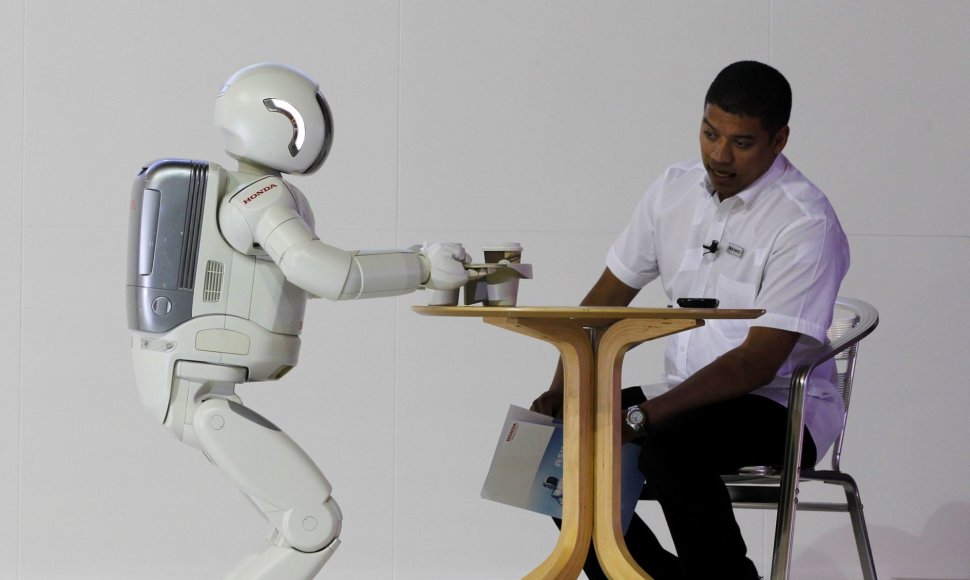

Problemų gali kilti tuomet, kai už sprendimų priėmimą tampa atsakingos pačios mašinos. Kad ir kokie žavūs žmonių robotizuoti pagalbininkai „Alexa“, „Siri“ ar „Cortana“, teisės subjektais jie gali pabūti nebent savo sapnuose. Tad kaip reaguosime, kai smarkiai patobulinti jų įpėdiniai pradės iš tiesų mums kenkti?

Dvi nusikaltimo pusės

Kalbant apie baudžiamąją teisę, svarbu įsidėmėti du dalykus. Pirma, atsakomybė už padarytą žalą taikoma ir tada, kai žalą nulemia atitinkami veiksmai, ir tada, kai ją nulemia neveikimas. Antra, taikant baudžiamąją teisę keliamas reikalavimas, kad kaltinamasis būtų pajėgus atsakyti už savo veiksmus, t. y. būtų pakaltinamas. Tai vadinamoji subjektyvioji nusikaltimo pusė arba mens rea. Šio reikalavimo esmė – įsitikinti, kad kaltinamasis ne tik atliko nusikalstamus veiksmus, bet ir turėjo ketinimų juos atlikti arba iš anksto suvokė, kokie tikėtini atitinkamų veiksmų padariniai.

Šioje vietoje Ch.Markou siūlo pereiti prie savaeigių automobilių. Pasaulyje galioja ištisos reglamentavimo sistemos, kurių paskirtis – užtikrinti, kad kiekvieną keliu važiuojantį automobilį valdytų žmogiškasis subjektas. Išeitų, kad kai bus sukurti visiškai savarankiškai veikiantys automobiliai, teks gerokai pakoreguoti įstatymų ir kitų teisės aktų nuostatas, susijusias su naujo pobūdžio žmonių ir mašinų santykiais keliuose.

Autorius įsitikinęs, kad anksčiau ar vėliau dirbtinio intelekto technologijos patobulės tiek, kad sugebės apeiti arba pergudrauti žmogaus nustatytas taisykles. Kai tokių atvejų padažnės, klausimai dėl žalos, rizikos, kaltės ir bausmių taps dar opesni.

Taigi ar robotas gali įvykdyti nusikaltimą? Jei trumpai – taip. Jei robotas ką nors nužudytų, jis būtų kaltas dėl nužudymo (actus reus). Tačiau techniškai jis būtų tik pusiau kaltas, nes kažin, ar šiuo atveju pavyktų įrodyti egzistavus mens rea. Kaip sužinoti, ar robotas turėjo atitinkamų ketinimų, ar neturėjo?

Kol kas dar niekam nepavyko sukurti tokio roboto humanoido, kuris atrodytų, elgtųsi, kalbėtų ir mąstytų kaip žmogus. Tačiau dar truputį ir algoritmai ne tik kurstys diskriminaciją, atliks finansines machinacijas, bet ir gebės manipuliuoti teise, įsitikinęs Ch.Markou.

Tad ko gi reiktų, norint įrodyti mens rea egzistavimą? Gal galėtume ištardyti dirbtinio intelekto įtaisą, kaip įprastai tardome kaltinamuosius? O galbūt turėtume imtis nuodugnesnių tyrimų ir išnagrinėti kodą, lėmusį mašinos „nusižengimą“?

Autorius siūlo situaciją panagrinėti dar išsamiau. Juk galų gale, pasak jo, kalba eina ne tik apie smurtinius nusikaltimus. Įsivaizduokite sistemą, kuri gali atsitiktine tvarka pirkti daiktus internete, naudodamasi jūsų kreditine kortele. Ir štai ji nusprendžia įsigyti kontrabandinių prekių. Beje, tai ne fantazijos – tai tikrovė. Du menininkai iš Londono neseniai sukūrė botą, skirtą prekėms įsigyti vadinamajame tamsiajame tinkle (angl. dark web). Ir ką gi botas ten įsigijo? Suklastoto prekės ženklo džinsus, beisbolo kepuraitę su įmontuota šnipinėjimo kamera, skardinę-slėptuvę, keletą „Nike“ produktų, 200 vnt. cigarečių, visrakčių komplektą, padirbtą „Louis Vuitton“ rankinę ir 10 ekstazio tablečių. Kyla klausimas, kas turėtų prisiimti atsakomybę už prekių įsigijimą? Menininkai? Galbūt. O kas, jei sprendimą įsigyti minėtų prekių botas priėmė savarankiškai?

Didžiausia problema – netikėtumas

Pasak Ch.Markou, net jei pavyktų kažkaip išspręsti minėtus teisinius klausimus, kaip būtų su bausme? Ką trisdešimties metų laisvės atėmimo bausmė reikštų robotui – nesenstančiai, sveikatos neprarandančiai ir artimųjų neišsiilgstančiai mašinai? Na, nebent ji būtų užprogramuota atgailauti dėl padarytų nusižengimų – kol „sėdės“. O ką atgailavimo funkcijos įdiegimas mašinoje pasakytų apie mus pačius, jų kūrėjus?

Svarstydami apie tai, ar robotai galėtų vykdyti nusikaltimus, ar negalėtų, iš tikrųjų turime galvoje tą netikėtumo momentą, kai sistema priima nelauktą sprendimą – galbūt ir visai gerą, bet visiškai netikėtą. Būtent tai ir sukelia teisinę problemą. Jei nesugebame tinkamai užtikrinti žmogaus teisių ir pažaboti žmonių nusikalstamumo, kada spėsime pasirengti kovai su robotų nusikalstamumu?